Foar BMS, BUS, Yndustrieel, Ynstrumintaasjekabel.

Elon Musk en it xAI-team hawwe offisjeel de lêste ferzje fan Grok, Grok3, lansearre tidens in livestream. Foarôfgeand oan dit barren ferhege in wichtige hoemannichte relatearre ynformaasje, keppele oan Musk's 24/7 promoasjehype, de wrâldwide ferwachtingen foar Grok3 nei noch nea earder sjoen nivo's. Krekt in wike lyn sei Musk selsbetrouwen tidens in livestream, wylst hy kommentaar joech op DeepSeek R1: "xAI stiet op it punt om in better AI-model te lansearjen." Ut 'e live presintearre gegevens hat Grok3 nei alle gedachten alle hjoeddeistige mainstreammodellen oertroffen yn benchmarks foar wiskunde, wittenskip en programmearring, wêrby't Musk sels beweart dat Grok3 brûkt wurde sil foar berekkeningstaken relatearre oan SpaceX's Mars-misjes, en foarsei "trochbraken op Nobelpriisnivo binnen trije jier." Dit binne lykwols op it stuit allinich Musk's útspraken. Nei de lansearring haw ik de lêste beta-ferzje fan Grok3 test en de klassike trúkfraach foar grutte modellen steld: "Hokker is grutter, 9.11 of 9.9?" Spitigernôch koe de saneamde tûkste Grok3 dizze fraach noch altyd net goed beantwurdzje sûnder kwalifikaasjes of markearrings. Grok3 slagge der net yn om de betsjutting fan 'e fraach krekt te identifisearjen.

Dizze test luts al gau flinke oandacht fan in protte freonen, en tafallich hawwe ferskate ferlykbere testen yn it bûtenlân sjen litten dat Grok3 muoite hat mei basisfragen oer natuerkunde/wiskunde lykas "Hokker bal falt earst fan 'e Toer fan Pisa?" Sa is it humoristysk bestimpele as "in sjeny dat net ree is om ienfâldige fragen te beantwurdzjen."

Grok3 is goed, mar it is net better as R1 of o1-Pro.

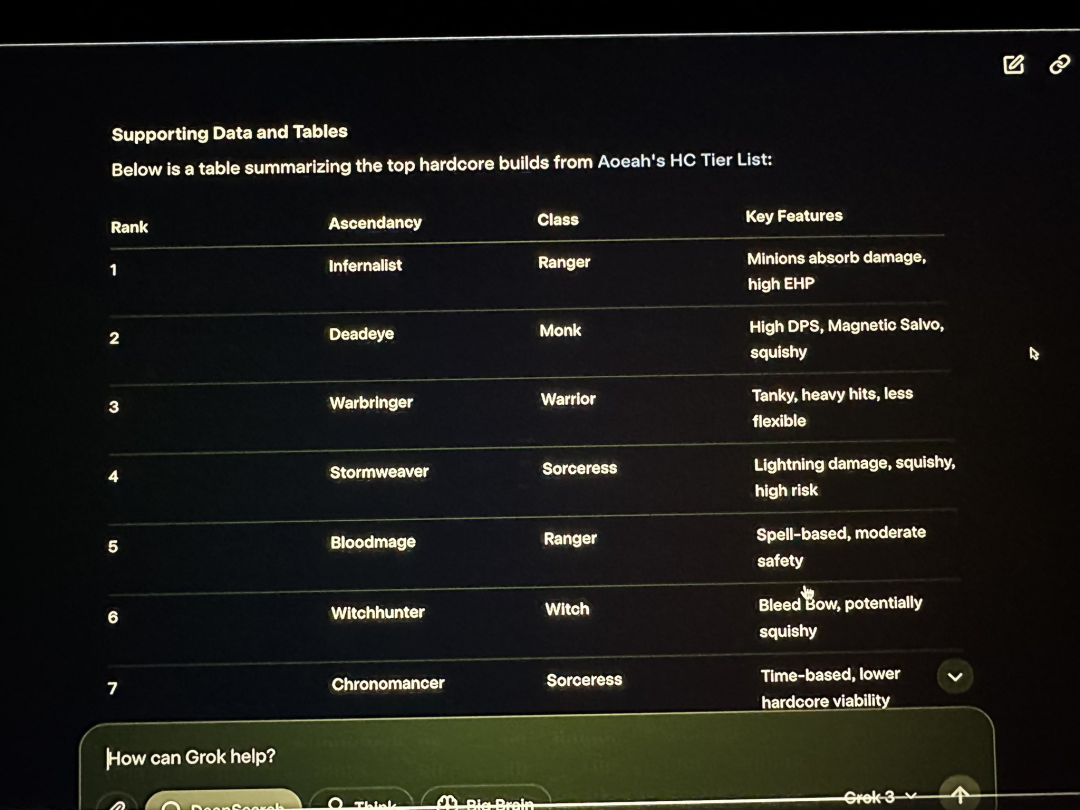

Grok3 hat yn 'e praktyk "flaters" ûnderfûn op in protte algemiene kennistests. Tidens it lansearingsevenemint fan xAI demonstrearre Musk it brûken fan Grok3 om de karakterklassen en effekten fan it spultsje Path of Exile 2 te analysearjen, dat hy beweart faak te spyljen, mar de measte antwurden dy't Grok3 joech wiene net korrekt. Musk hat dit dúdlike probleem net opmurken tidens de livestream.

Dizze flater levere net allinich fierder bewiis foar bûtenlânske netizens om Musk te bespotten foar it "finen fan in ferfanging" yn gaming, mar soarge ek foar wichtige soargen oer de betrouberens fan Grok3 yn praktyske tapassingen. Foar sa'n "sjeny", nettsjinsteande syn werklike mooglikheden, bliuwt syn betrouberens yn ekstreem komplekse tapassingsscenario's, lykas Mars-ferkenningstaken, yn twifel.

Op it stuit wize in protte testers dy't wiken lyn tagong krigen ta Grok3, en dyjingen dy't juster de modelmooglikheden in pear oeren testen hawwe, allegear op in mienskiplike konklúzje: "Grok3 is goed, mar it is net better as R1 of o1-Pro."

In kritysk perspektyf op "Nvidia fersteure"

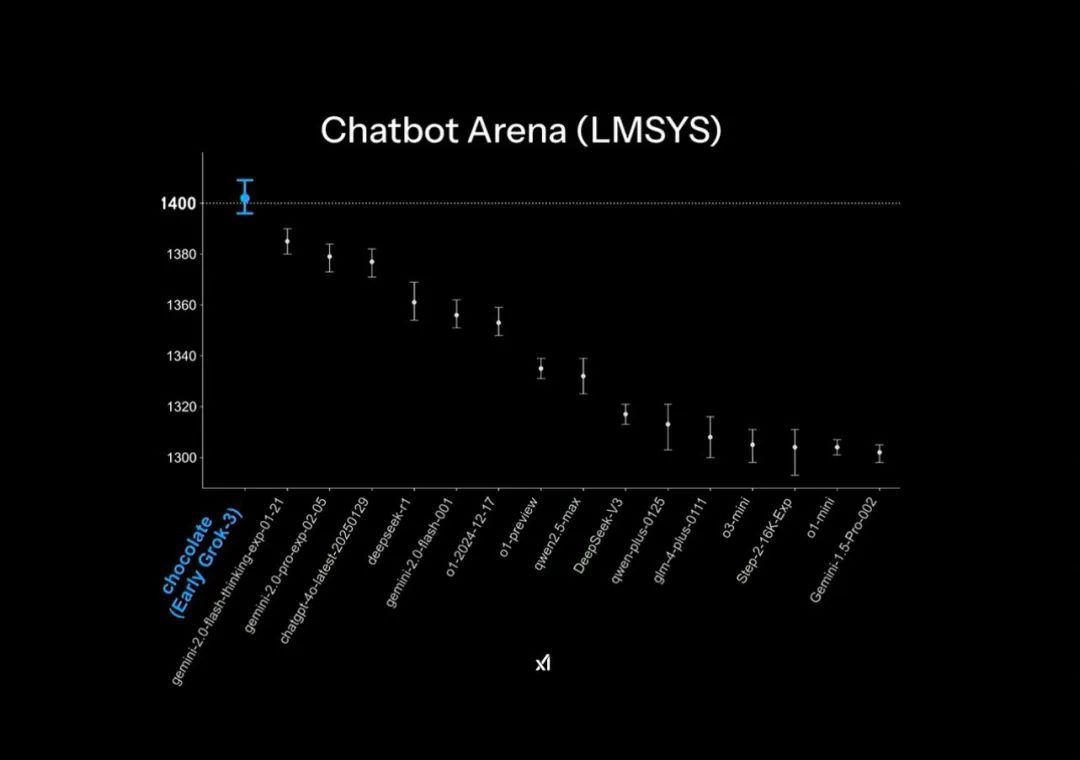

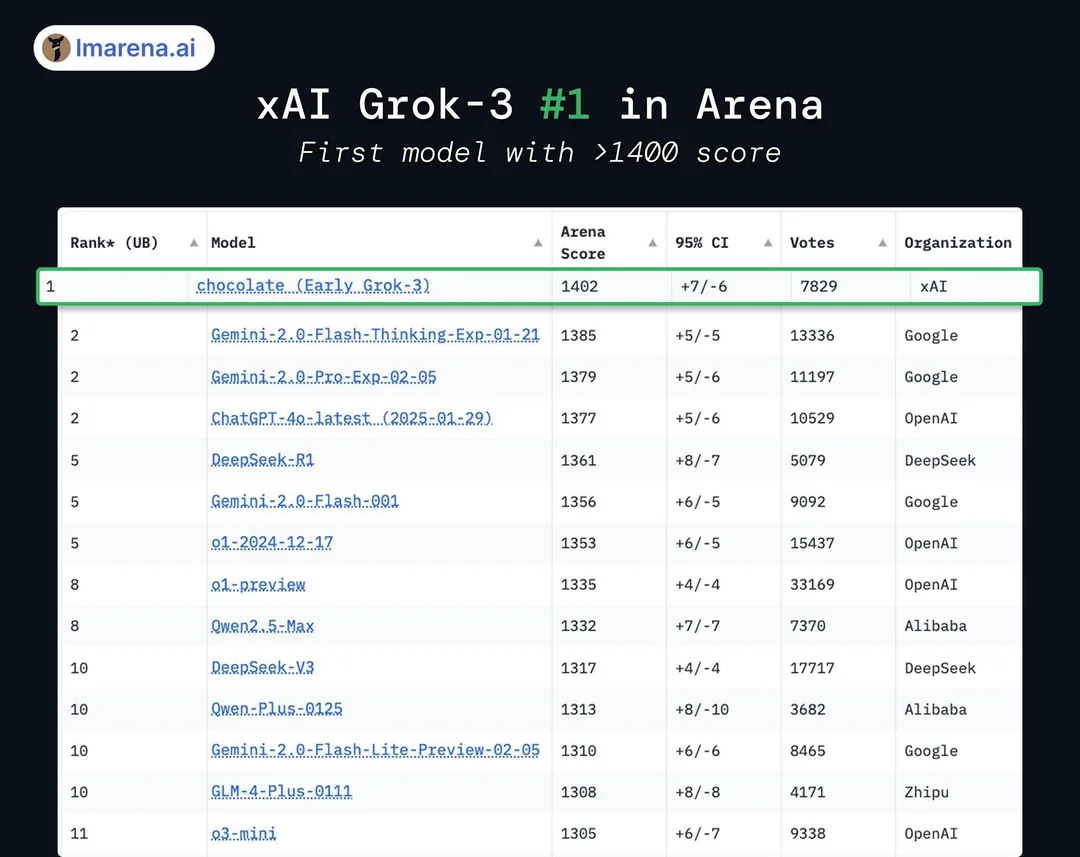

Yn 'e offisjeel presintearre PPT tidens de release waard sjen litten dat Grok3 "fier foarút" wie yn 'e Chatbot Arena, mar dit brûkte op in tûke manier grafyske techniken: de fertikale as op it klassemint liet allinich resultaten sjen yn it skoareberik fan 1400-1300, wêrtroch it orizjinele ferskil fan 1% yn testresultaten útsûnderlik signifikant liket yn dizze presintaasje.

Yn werklike modelskoareresultaten is Grok3 mar 1-2% foar op DeepSeek R1 en GPT-4.0, wat oerienkomt mei de ûnderfiningen fan in protte brûkers yn praktyske testen dy't "gjin merkber ferskil" fûnen. Grok3 oertreft syn opfolgers mar mei 1%-2%.

Hoewol Grok3 heger skoard hat as alle op it stuit iepenbier testte modellen, nimme in protte dit net serieus: xAI is ommers earder yn it Grok2-tiidrek bekritisearre foar "skoaremanipulaasje". Om't it klassemint de styl fan antwurdlingte bestraft, sakken de skoares sterk, wêrtroch't yndustry-insiders faak it ferskynsel "hege skoare mar lege feardigens" kritisearren.

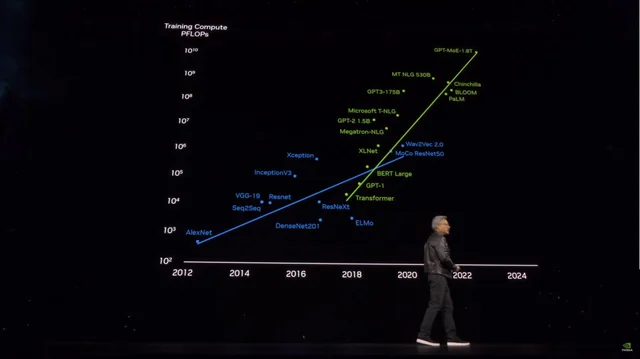

Oft it no troch "manipulaasje" fan it klassemint is of troch ûntwerptrúkjes yn yllustraasjes, se litte xAI en Musk syn obsesje mei it idee fan "foaroprinnen" yn modelmooglikheden sjen. Musk betelle in hege priis foar dizze marzjes: tidens de lansearring pronkte hy mei it brûken fan 200.000 H100 GPU's (en bewearde "mear as 100.000" tidens de livestream) en it berikken fan in totale trainingstiid fan 200 miljoen oeren. Dit late guon ta it leauwen dat it in oare wichtige segen foar de GPU-yndustry fertsjintwurdiget en de ynfloed fan DeepSeek op 'e sektor as "ûnferstannich" beskôge. It is opmerklik dat guon leauwe dat pure rekkenkrêft de takomst fan modeltraining sil wêze.

Guon netizens fergelike lykwols it ferbrûk fan 2000 H800 GPU's oer twa moannen om DeepSeek V3 te produsearjen, en berekkene dat it werklike trainingsferbrûk fan Grok3 263 kear dat fan V3 is. It ferskil tusken DeepSeek V3, dy't 1402 punten skoarde, en Grok3 is krekt ûnder de 100 punten. Nei de frijlitting fan dizze gegevens realisearren in protte har al gau dat efter de titel fan Grok3 as de "sterkste fan 'e wrâld" in dúdlik marzjinaal nutseffekt leit - de logika fan gruttere modellen dy't sterkere prestaasjes generearje, begjint ôfnimmende rendeminten te sjen litten.

Sels mei "hege skoare mar lege feardigens", hie Grok2 enoarme hoemannichten hege kwaliteit first-party gegevens fan it X (Twitter) platfoarm om gebrûk te stypjen. Yn 'e training fan Grok3 kaam xAI lykwols fansels tsjin it "plafond" oan dêr't OpenAI op it stuit mei te krijen hat - it gebrek oan premium trainingsgegevens bleatleit fluch it marginale nut fan 'e mooglikheden fan it model.

De ûntwikkelders fan Grok3 en Musk binne wierskynlik de earsten dy't dizze feiten djip begripe en identifisearje, dêrom hat Musk op sosjale media hieltyd neamd dat de ferzje dy't brûkers no ûnderfine "noch mar de beta" is en dat "de folsleine ferzje yn 'e kommende moannen útbrocht wurdt". Musk hat de rol fan produktmanager fan Grok3 op him nommen, en suggerearret dat brûkers feedback jouwe oer ferskate problemen dy't se tsjinkomme yn 'e kommentaarseksje. Hy is miskien wol de meast folge produktmanager op ierde.

Dochs, binnen in dei, hawwe de prestaasjes fan Grok3 sûnder mis alarm opsmiten by dyjingen dy't hopen te fertrouwen op "massive kompjûterkrêft" om sterkere grutte modellen te trainen: basearre op iepenbier beskikbere ynformaasje fan Microsoft hat OpenAI's GPT-4 in parametergrutte fan 1,8 triljoen parameters, mear as tsien kear dy fan GPT-3. Geroften suggerearje dat de parametergrutte fan GPT-4.5 miskien noch grutter is.

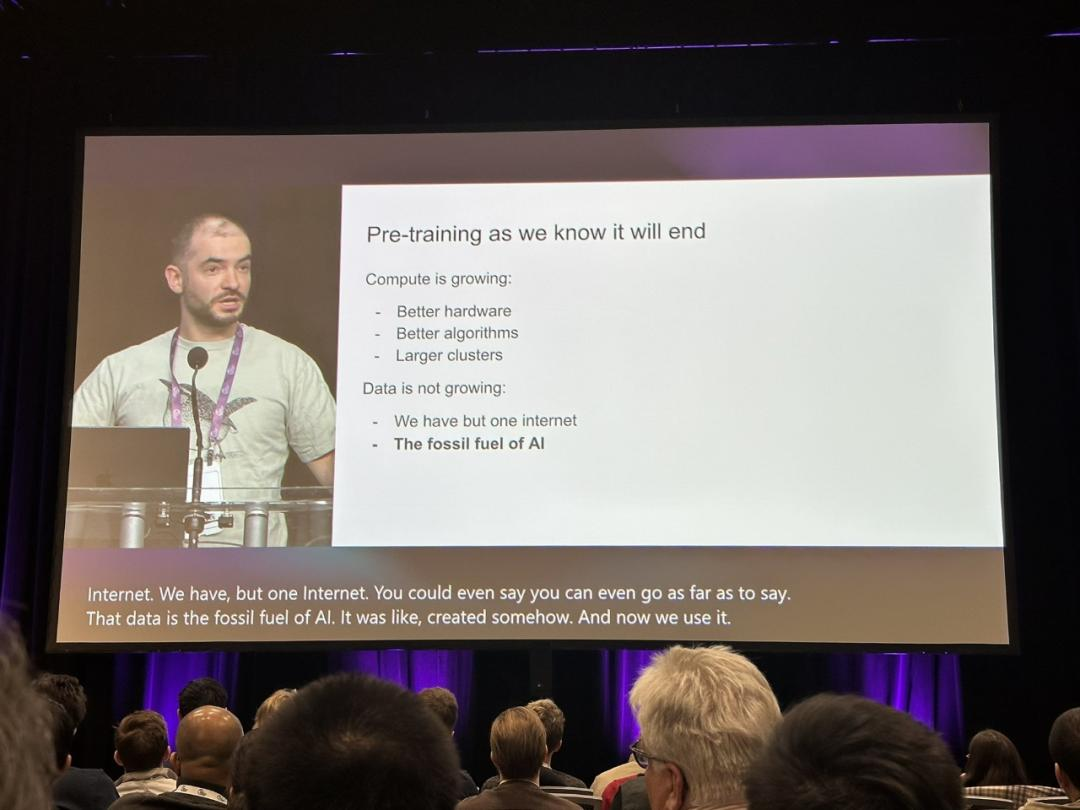

As de grutte fan 'e modelparameters omheech giet, geane de trainingskosten ek omheech. Mei de oanwêzigens fan Grok3 moatte konkurrinten lykas GPT-4.5 en oaren dy't "jild ferbaarne" wolle om bettere modelprestaasjes te berikken troch parametergrutte, it plafond beskôgje dat no dúdlik yn sicht is en neitinke oer hoe't se it oerwinne kinne. Op dit stuit hie Ilya Sutskever, eardere haadwittenskipper by OpenAI, earder ferline desimber sein: "De foartraining dêr't wy mei bekend binne, sil ta in ein komme", wat wer opdûkt is yn diskusjes, wat oanlieding jûn hat ta ynspanningen om it wiere paad te finen foar it trainen fan grutte modellen.

It stânpunt fan Ilya hat alarm lutsen yn 'e sektor. Hy foarsei krekt de dreigende útputting fan tagonklike nije gegevens, wat liede soe ta in situaasje wêrby't prestaasjes net fierder ferbettere wurde kinne troch gegevensakwisysje, en fergelike it mei de útputting fan fossile brânstoffen. Hy joech oan dat "lykas oalje, minsklik generearre ynhâld op it ynternet in beheinde boarne is." Yn Sutskever syn foarsizzingen sil de folgjende generaasje modellen, nei pre-training, "echte autonomy" en redenearringsmooglikheden hawwe "fergelykber mei it minsklik brein."

Oars as de foarôf oplate modellen fan hjoed de dei dy't benammen fertrouwe op ynhâldsmatching (basearre op 'e earder leard modelynhâld), sille takomstige AI-systemen yn steat wêze om metodologyen te learen en te fêstigjen om problemen op te lossen op in manier dy't liket op it "tinken" fan it minsklik brein. In minske kin fûnemintele feardigens yn in ûnderwerp berikke mei allinich basis profesjonele literatuer, wylst in grut AI-model miljoenen datapunten fereasket om allinich de meast basale yngongsnivo-effektiviteit te berikken. Sels as de formulering wat feroare wurdt, kinne dizze fûnemintele fragen miskien net goed begrepen wurde, wat yllustrearret dat it model net echt ferbettere is yn yntelliginsje: de basis, mar ûnoplosbere fragen dy't oan it begjin fan it artikel neamd binne, binne in dúdlik foarbyld fan dit ferskynsel.

Konklúzje

Mar, bûten brute krêft, as Grok3 yndie slagget om oan 'e yndustry te iepenbierjen dat "foarôf opliede modellen har ein naderen", soe it wichtige gefolgen hawwe foar it fjild.

Miskien nei't de razernij om Grok3 stadichoan ôfnimt, sille wy mear gefallen tsjûgje lykas it foarbyld fan Fei-Fei Li fan "it ôfstimmen fan hege prestaasjesmodellen op in spesifike dataset foar mar $50", en úteinlik it wiere paad nei AGI ûntdekke.

Kontrôlekabels

Strukturearre kabelsysteem

Netwurk en gegevens, glêstriedkabel, patchkabel, modules, frontplaat

16-18 april 2024 Midden-Easten-Enerzjy yn Dubai

16-18 april 2024 Securika yn Moskou

9 maaie 2024 LANSEARJINGSEVENEMINT FAN NIJE PRODUKTEN EN TECHNOLOGYEN yn Shanghai

22-25 oktober 2024 FEILIGHEID SINA yn Peking

19-20 novimber 2024 FERBUNNE WRÂLD KSA

Pleatsingstiid: 19 febrewaris 2025